目次

衝撃のデータ:2050年、「ミスがないこと」の価値は暴落する?

「ChatGPTは薬剤師の仕事を奪うのか」「DI業務に使っても大丈夫なのか」

最近、薬局の現場でもこうした話題が増えてきました。新しい技術には期待がある一方で、「嘘をつく(ハルシネーション)」というリスクも広く知られるようになり、導入に二の足を踏んでいる方も多いのではないでしょうか。

しかし、ある衝撃的なデータを見てから、私の考えは変わりました。「AIを使うかどうか」は、単なる便利ツールの話ではなく、私たちが今後数十年生き残れるかどうかの分岐点になっているからです。

- 2050年に薬剤師に求められる「意外なスキル」の正体

- DI業務でAIに「絶対に任せてはいけない」境界線

- 事務・学習効率を劇的に上げる具体的な活用法

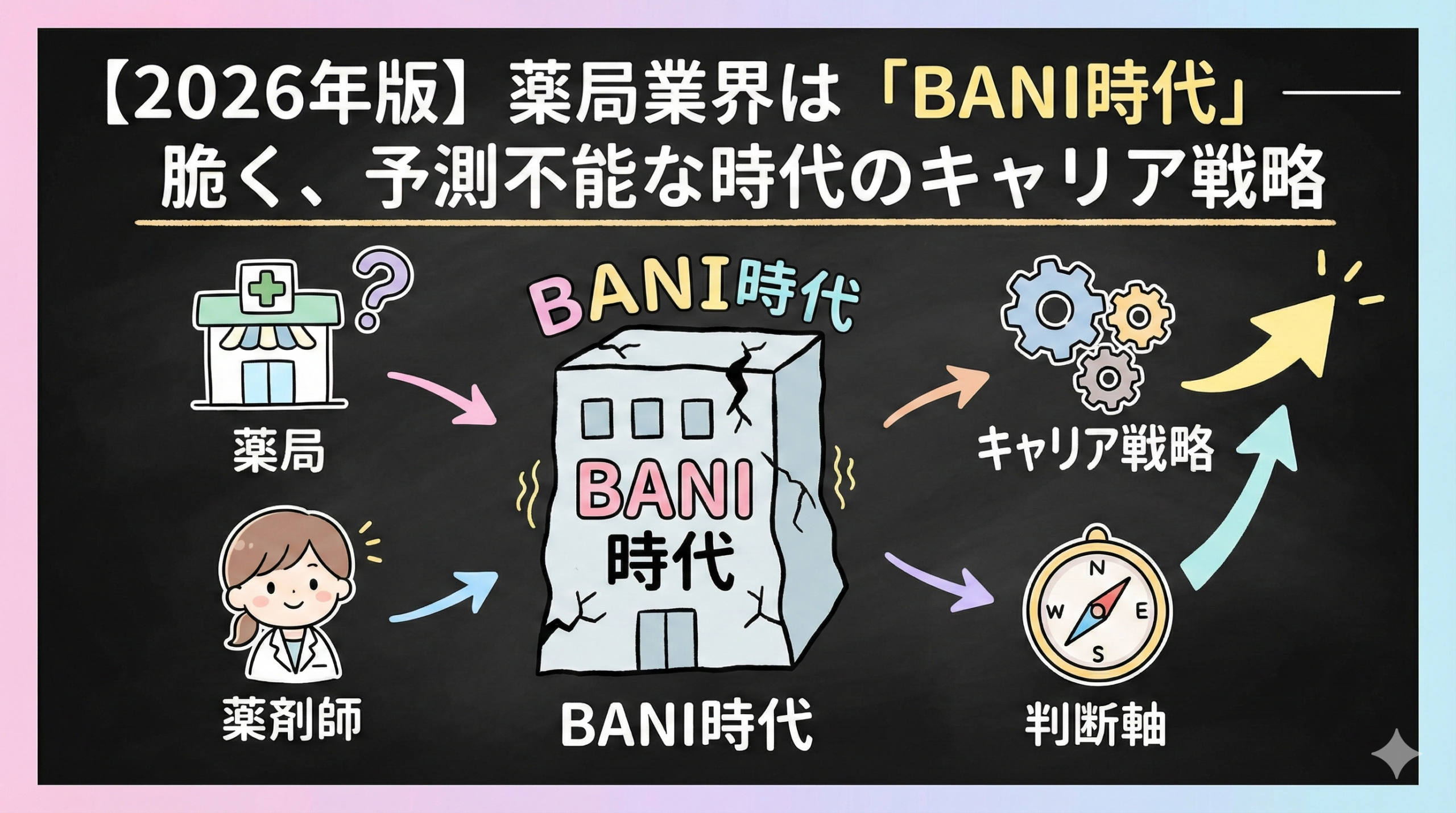

「守りのスキル」から「攻めのスキル」への大転換

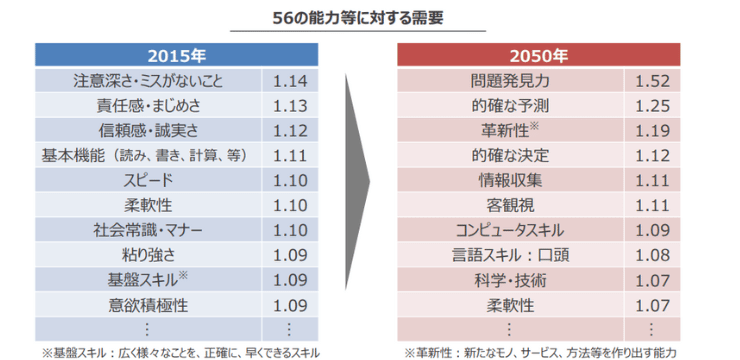

まず、なぜ私たちがChatGPTのようなAIと向き合う必要があるのか。その答えが明確に示されているデータがあります。これは2015年と2050年で「仕事において求められる能力」がどう変わるかを予測したものです。

2015年の欄を見てください。「注意深さ・ミスがないこと」「責任感・まじめさ」が上位を占めています。これはまさに、私たち薬剤師が日々、調剤過誤を起こさないために神経をすり減らしている領域ですよね。

しかし、2050年の予測は様変わりしています。

1位は「問題発見力(1.52)」。次いで「的確な予測」「革新性」と続きます。

ここから読み取れる残酷な現実は、「ただ正確に業務をこなす(ミスがない)」だけの価値は相対的に下がり、「何が問題なのかを見つける」能力の価値が急騰するということです。

AI活用は「サボり」ではなく「シフト」のための手段

「正確性」や「基本機能(計算など)」は、AIやロボットが最も得意とする領域です。

つまり、AIができることはAIに任せ、空いた手と頭で人間にしかできない「問題発見」や「的確な決定」を行える薬剤師にならなければならない。これが、私たちがChatGPTを学ぶべき本当の理由です。

えっ、ちょっと待ってください。「ミスしないこと」が大事じゃなくなるなんて信じられません! 監査でミスしたら終わりですよ?

オカメインコ

ポッポ先生

もちろん医療現場でミスは許されません。ですが、「人間が気合でミスを防ぐ時代」から、「ミス防止はシステム(AI)に任せて、人間は『患者さんの隠れた悩み』を発見する時代」に変わるということです。

医薬品情報(DI)の検索:AIに「正確性」を求めてはいけない

ここで重要になるのが、「AIに任せるべき仕事」と「任せてはいけない仕事」の境界線です。

特にDI業務において、誤解されやすいので先に言うと、「用法用量や相互作用の確認」にChatGPTを単体で使うのは危険すぎるため、推奨しません。

理由は先ほどのデータとも関連します。ChatGPTは「確率的にありそうな言葉」を作っているだけで、「事実(正確性)」を保証するものではないからです。

現場で陥りがちな「確認コスト」の罠

「でも、答えを出させてから添付文書で裏を取ればいいのでは?」と思うかもしれません。

しかし、私ならこの使い方は避けます。なぜなら、「AIが出したもっともらしい嘘」の真偽を確認する作業は、最初からインタビューフォームを開くよりも時間がかかることが多いからです。

「情報の正確性が100%求められる場面(=2015年型のスキル領域)」では、既存の信頼できるデータベース(PMDA、添付文書)を使うのが鉄則です。

DI業務で「使える」例外パターン

ただし、以下のような「網羅的なリストアップ」や「翻訳」の補助には役立ちます。これは2050年型スキルの「情報収集」を加速させる使い方です。

- 逆引きのヒント出し

例:「副作用として『味覚障害』が報告されている降圧薬のクラスを列挙して」

※あくまで「ヒント」として使い、必ず裏取りをする前提です。 - 海外論文の要約・翻訳

例:「この論文のAbstractを、箇条書きで日本語に要約して」

事務・文章作成:「0→1」の下書きはAIに任せる

ChatGPTが最も輝くのは、正解が一つではない「文章作成」や「アイデア出し」です。

これらは、私たちが本来時間を割くべき「患者さんとの対話」や「問題発見」の時間を奪っている元凶でもあります。ここをAIに外注しましょう。

1. 患者向け説明資料(指導箋)の作成補助

特定の疾患について、柔らかい言葉で説明文を作りたいとき。「専門用語を使わずに」と指定することで、驚くほどわかりやすい文章が生成されます。

「高血圧の患者さん向けに、減塩のコツを3つ紹介するコラムを書いてください。説教くさくならず、明日からすぐに実践できる具体的な内容で、文字数は300文字程度、親しみやすいトーンでお願いします」

2. クレーム対応やお詫びメールの下書き

精神的に負荷がかかる「お詫びの文章」や、取引先への「お断りのメール」。これらをゼロから考えるのはストレスですよね。

状況と伝えたい要点を箇条書きで入力し、「丁寧なビジネスメールにして」と頼めば、10秒でたたき台が完成します。

| 業務の種類 | ChatGPTの適性 | 理由(判断軸) |

|---|---|---|

| DI回答(用法等) | × 不可 | 誤情報のリスク大。ここは人間とDBが担う |

| 論文翻訳・要約 | △ 検証要 | 概要把握の時短にはなる |

| 患者向け資料作成 | ◎ 推奨 | 表現の工夫が得意。「伝える力」を補完 |

| メール・日報作成 | ◎ 推奨 | 「0→1」の負荷を下げ、時間を生む |

文章を作ってもらうのはいいけど、自分の言葉じゃないみたいで冷たく感じませんか?

オカメインコ

ポッポ先生

その感覚は大事ですね。だからこそ「下書き(ドラフト)」なんです。AIに80点のたたき台を作らせて、人間が「的確な決定(修正)」を行う。これこそ、これからの働き方ですね。

学習・スキルアップ:「問題発見力」を鍛える壁打ち

3つ目の活用法は、薬剤師自身の「学習」です。

2050年に求められる「問題発見力」や「的確な予測」を鍛えるために、ChatGPTを壁打ち相手として使いましょう。

自分の理解度を試す「クイズ化」

新しい薬やガイドラインを勉強した際、ただ読むだけでは「わかったつもり」になりがちです。

そんな時、私ならこう問いかけます。

「私は薬剤師です。慢性心不全の治療ガイドラインにおける『ARNI』の位置づけについて、薬理作用の観点から私にクイズを出してください。私が回答した後、解説をしてください」

模擬患者(ロールプレイ)で「予測」を鍛える

服薬指導のシミュレーションも可能です。

「あなたは薬に不安を持っている高齢の患者さんになりきってください。私が説明するので、少し頑固な態度で質問を返してください」

こう設定すれば、「患者さんが次に何を不安に思うか」を予測するトレーニングになります。

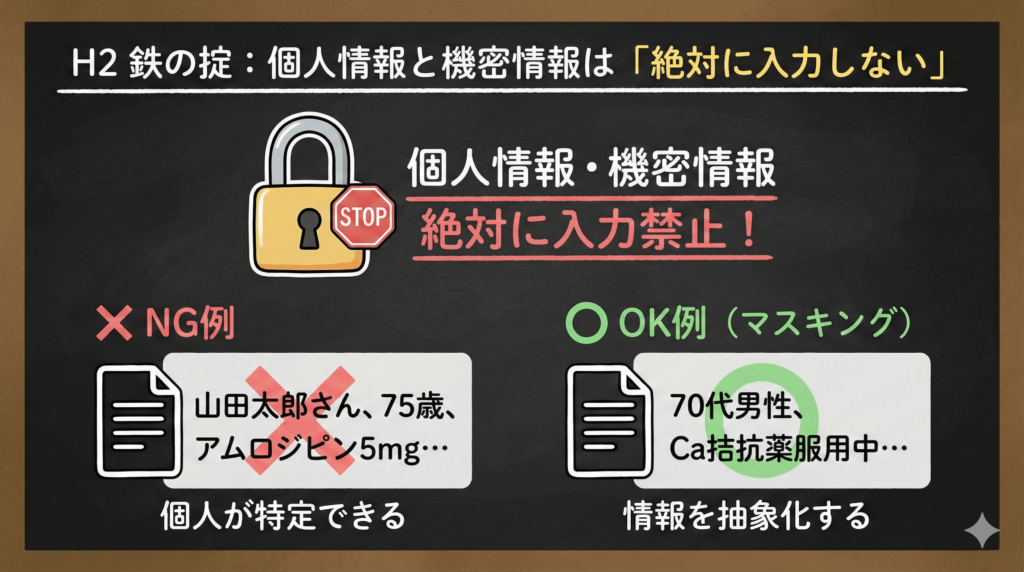

鉄の掟:個人情報と機密情報は「絶対に入力しない」

最後に、セキュリティに関する絶対的な境界条件をお伝えします。

「患者さんの個人情報(氏名、住所、生年月日など)」や「薬局の未公開データ」は、絶対に入力してはいけません。

「注意深さ・ミスがないこと」の需要が下がるとはいえ、それは「AIがやってくれるから」であって、情報漏洩のようなミスが許容されるわけではありません。むしろ、コンプライアンス順守は前提条件(足切りライン)として残り続けます。

具体的なマスキングの方法

薬歴(SOAP)の要約や整理を頼みたい場合は、以下のように情報を抽象化(マスキング)してください。

- ×「山田太郎さん、75歳、アムロジピン5mg服用中」

- ○「70代男性、Ca拮抗薬服用中」

まとめ:AI活用は「生き残るためのシフトチェンジ」

薬剤師がChatGPTと付き合う上で大事なのは、「楽しそうだから使う」だけでなく、「時代の変化に適応するために使う」という視点です。

- DI(事実確認)には使わない

正確性は既存DBに任せる。 - 事務・文章作成に使う

時間を浮かせ、2015年型の働き方から脱却する。 - 「問題発見」のために使う

浮いた時間で患者さんと向き合い、壁打ちで思考力を磨く。

冒頭のデータが示した通り、「言われたことをミスなくやる」だけでは評価されにくい時代が近づいています。

AIを「優秀な新人事務員」として雇い、単純作業を任せることで、あなたは人間にしかできない「患者さんの本当の問題を見つける仕事」にシフトしてください。

ポッポ先生

次の一歩として、まずは「業務と無関係なこと」から話しかけてみませんか?

例えば「今晩の冷蔵庫の残り物で作れるレシピを考えて」など。まずはAIの「答え方の癖」を掴むことから、小さな検証を始めてみてください。